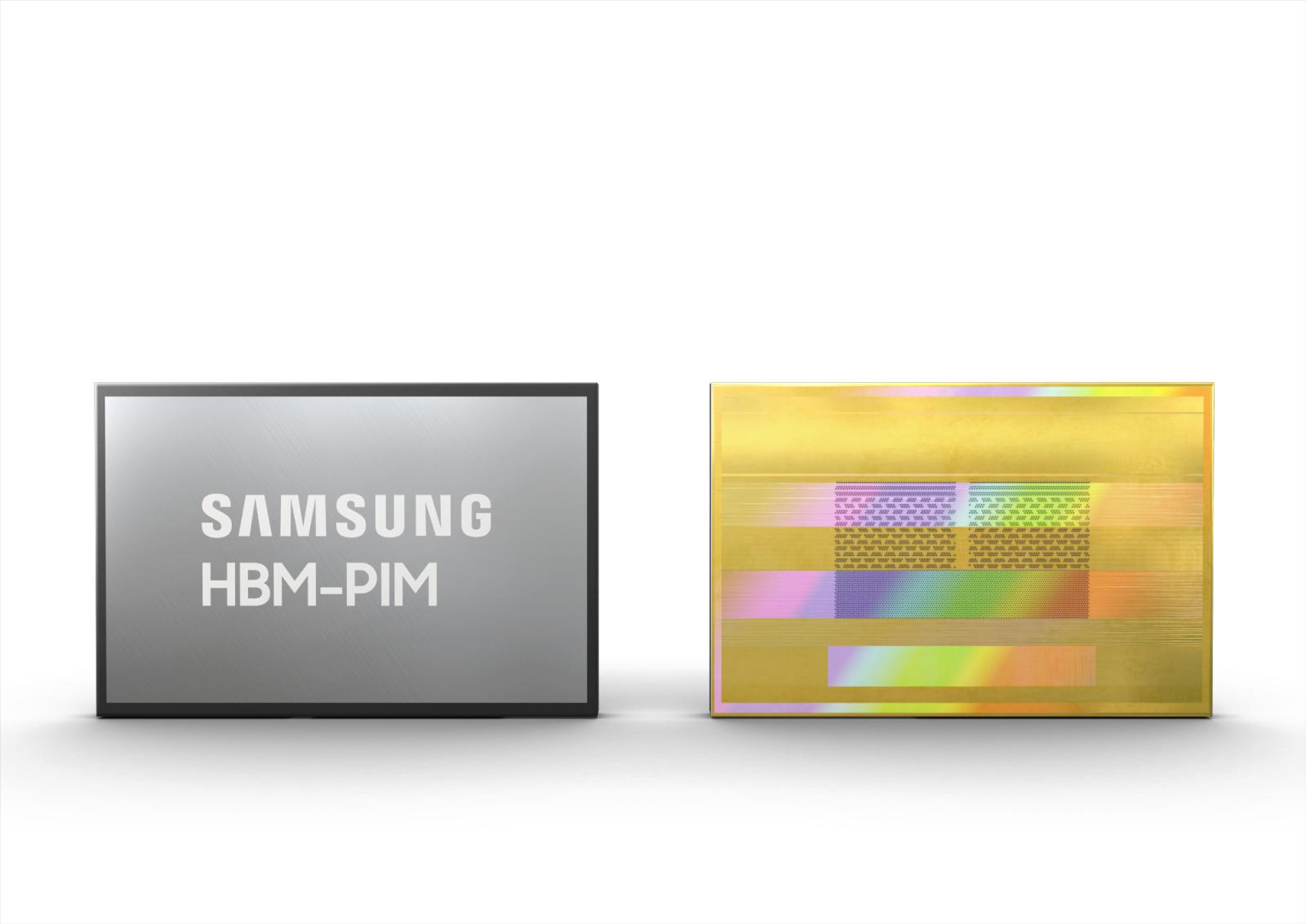

三星(Samsung)發布整合人工智慧(AI)處理器的高頻寬記憶體(HBM),其採用的記憶體內運算(PIM)架構,能夠在高效能記憶體中整合AI運算能力,用以加速資料中心、HPC系統及AI相關的行動裝置應用的處理速度。

三星記憶體產品規畫資深副總裁Kwangil Park表示,三星的HBM-PIM是業界首款使用可程式化的PIM解決方案,來減輕AI的HPC、訓練及推論的工作量。團隊計畫透過結合更先進的AI解決方案,開發更多由PIM驅動的應用。

目前多數的運算系統都使用馮紐曼架構,採用個別的處理器與記憶體單元來處理數百萬的複雜數據。這樣的處理流程需要數據來回移動,導致系統運作緩慢,且在數據大量增加時尤其嚴重。

相比馮紐曼架構,HBM-PIM透過記憶體內DRAM優化後的AI引擎,達到平行處理及盡可能減少數據移動的目標。因此如果使用三星的HBM2 Aquabolt解決方案,新的架構能夠在提升系統效能兩倍的同時,大幅度減少超過70%的功耗。並且HBM-PIM的導入,不需要改變任何現有的軟硬體設備,能夠快速整合進系統中。

三星近期針對HBM-PIM發表的論文,已經受到國際固態電路會議(ISSCC)採用。同時AI加速的合作夥伴正在測試HBM-PIM,預計在2021上半年完成。