AI已從利基技術轉變為人們每天與之互動的技術,成長範圍已超越工程和技術領域。此趨勢促使幾乎各行各業的公司都在考慮如何運用AI來提升效率,降低成本,並提升產品功能。廣泛可用的雲端式AI解決方案具備可存取性和使用便利性,讓幾乎所有人都能更輕鬆地使用專為AI設計的模型和工具。

然而,並非所有AI創新都會在雲端進行。隨著嵌入式處理器設計的技術進步,AI功能也逐漸導入筆記型電腦、行動電話等消費產品以及其他電子產品:視訊門鈴等電池供電應用、汽車系統視覺處理,以及能源基礎架構與工業系統中的馬達。

邊緣AI是在資料來源附近本機執行AI模型的能力,可提升電子產品的回應性、效率、可靠性和安全性。嵌入式處理器讓此類雲端到邊緣的轉型成為可能,整合了用於數位訊號處理(DSP)的專用核心等元件,並由易於使用的GUI架構工具支援,可將AI導入邊緣所需的時間和專業知識降到最低。

在本白皮書中將探討邊緣AI的演進與優勢,以及支援邊緣AI的軟硬體的進步。

AI是機器展現某種智慧或推理的能力。現在大多數人想到AI時,通常會聯想到文字和圖像生成器,或是電玩遊戲中的虛擬對手。但即使是最簡單的演算法,在技術上也是文字意義上AI的範例。

AI的廣泛性及其多重使用案例催生了多個子領域,包括機器學習和深度學習。

用於嵌入式應用的大多數AI為機器學習,這是機器和演算法「學習」如何解決問題的子領域;例如,車輛透過分析通用模式的影像資料來辨識行人與障礙物。機器學習模型也可透過接收大量訓練資料或已標記的資料來進行學習。

此訓練程序可讓機器學習模型能夠辨識資料中的模式,並可用於進行未來的推論。

在機器學習領域中,雖然深度學習需要大量的運算資源,但因其能準確地解決高度複雜的問題,已成為最受歡迎的實作方式之一。深度學習使用多層神經網路,這是受人腦神經元啟發的資料模型。此技術可讓產品設計人員能建立解決方案來辨識自己無法分辨的模式。

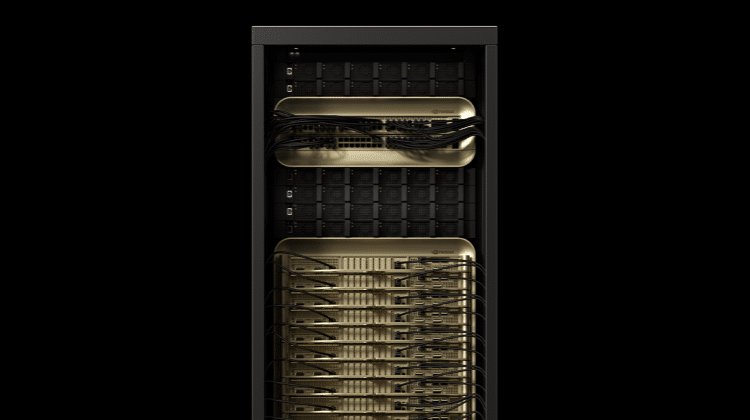

AI及其子領域通常可在雲端或本機硬體上執行處理。雲端式AI在過去較為普遍,因為要在大型伺服器之外執行有影響力AI所需的運算能力並不是容易達成的條件。然而,隨著嵌入式處理器的運算能力和電源效率不斷提升,邊緣AI也日益普及。

邊緣AI通常會在開發期間使用雲端或桌上型電腦資源進行模型訓練。將模型部署至嵌入式裝置後,即可在本機獨立地對新資料進行模型推論和決策。

直到最近,最有意義的AI範例所需的處理能力均超出一般消費性電子產品所能提供的能力。這意謂著機器學習模型通常是在雲端式資源上進行訓練和實作。雖然雲端式架構實作透過最大限度地減少硬體投資而提供了便利性,但也限制了AI的採用。雲端式AI實作無法在沒有雲端存取(即網路連線)的任何應用程式中使用。此外,與雲端式AI相比,邊緣AI還可以提高保全性、安全性和回應能力。

隨著半導體的進步和AI工具鏈的改善,現在已可將AI解決方案直接導入嵌入式處理器和微控制器(MCU),進一步將AI推展至邊緣。將AI帶入邊緣意謂著運算和AI推論要在提供資料的感測器附近執行,因此必須考慮到電子裝置收集的感測器資料量會持續增加。不斷成長的資料量使得純雲端資源變得不太實用,因為從雲端傳輸大量資料可能使成本高昂且過程複雜,並且會出現單點故障。

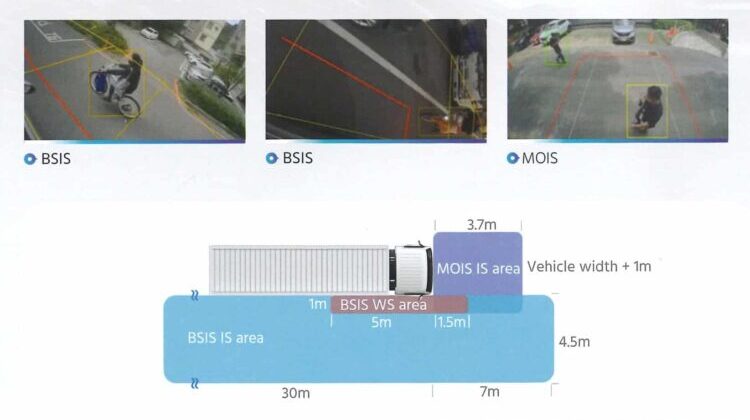

在網路邊緣執行AI模型通常可減少根據感測器資料進行推論和決策的延遲,例如車輛中用於碰撞偵測的攝影機感測器。運用邊緣AI功能,車輛可以更快速地進行推論,即時回應刺激,無需等待來自雲端的推論。

與雲端式AI相比,邊緣AI具有其他多項優勢,包括減少對網路連線的依賴。邊緣AI可用於無法存取雲端的應用,並將網路中斷造成的潛在停機時間降至最低。此外,由於雲端式AI需要網路連線,因此可能會產生經常性的存取服務費,這在設計消費產品時可能是一個具有挑戰性的商業模式。

接著說明嵌入式處理器和易於使用的網路型軟體的進步,如何協助更多設計人員在設計中啟用邊緣AI功能。

邊緣AI硬體創新:過去,嵌入式處理器的處理與功耗限制,以及高階內部編程專業知識和資源,都限制了邊緣AI的普及性。可滿足AI運算性能需求的嵌入式裝置通常體積過大、功耗過高,且會產生過多熱能。

近年來,市場上出現了專門的硬體解決方案,可以更有效地加速邊緣人工智慧所需的運算操作。但這些硬體解決方案都各自存在著一些優缺點,因而限制了其在邊緣應用中的廣泛採用。雖然圖形處理單元(GPU)、現場可編程閘陣列(FPGA)和特定應用積體電路(ASIC)等專用硬體解決方案已經能夠達到令人印象深刻的成果,但通常受到功耗的限制(特別是在GPU和FPGA)或缺乏彈性(就ASIC而言)。

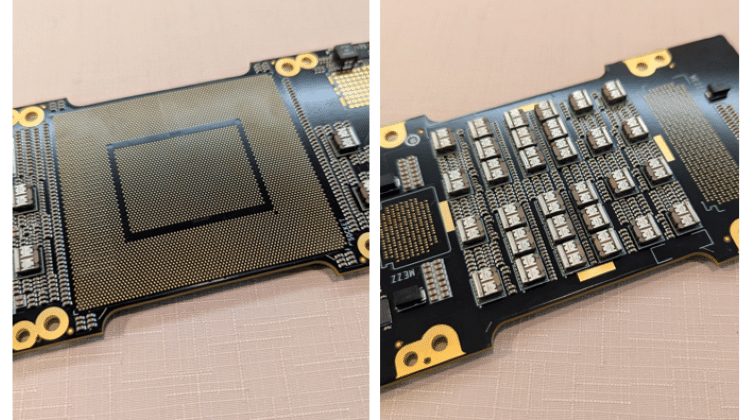

而具備整合式邊緣AI功能的新型嵌入式處理器解決了這些功耗限制和成本考量。其中許多裝置皆配備了神經處理單元(NPU)和/或數位訊號處理器(DSP)等整合式元件。

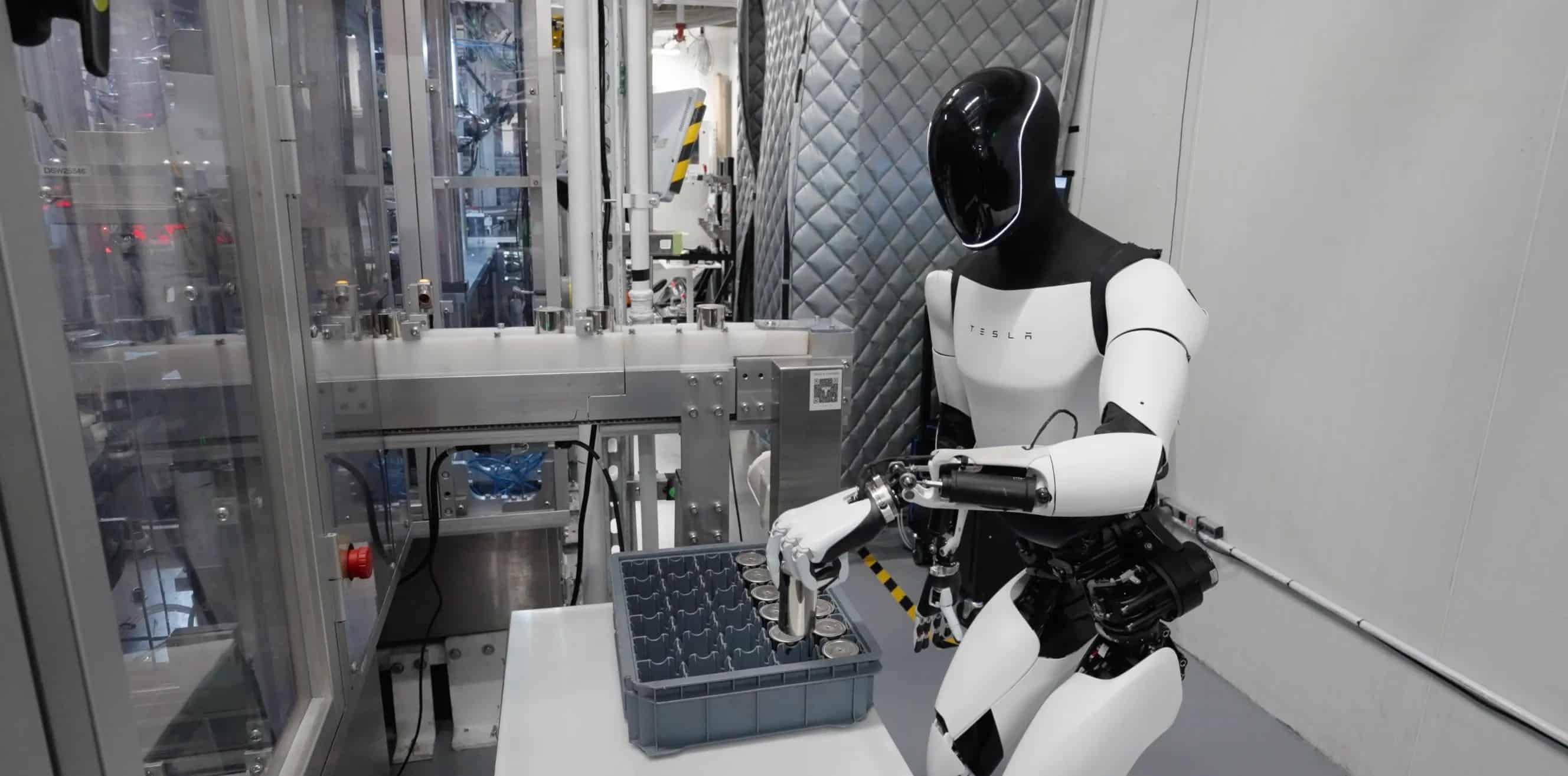

NPU是一種專用硬體加速器,可整合至嵌入式處理器設計中,提供所需的運算等級。例如,如TMS320F28P550SJ等TI的TMS320F28P55x系列即時C2000 MCU具有適用於馬達軸承和太陽能電弧故障偵測的晶片內建NPU,可分擔主要CPU的處理負荷,以進行即時馬達控制。及早偵測到故障有助於減少停機時間和維修成本,同時也能提升安全性。馬達故障偵測在暖氣、通風、空調(HVAC)、工廠自動化、機器人和電動車等應用中扮演著關鍵的角色。這些應用可以使用從各種感測器匯總的時間序列資料,進行準確的推論,並快速偵測系統中的異常狀況。

對於視覺處理等感知型應用,微處理器需包含視覺管線的必要元件,以及能夠滿足AI性能所需的NPU。TI的分析處理器(如AM67A和TDA4VM)具有整合式深度學習加速器,可將AI性能和功耗最佳化。這些深度學習加速器均由C7x DSP及附加矩陣相乘加速器組成,可大幅改善視覺處理中常見神經網路的處理性能。此架構運用TI的DSP技術,透過將AI運算集中在同質運算元件上,進行有效率的資料移動,並將功耗最佳化。

為了確保嵌入式處理器盡可能地易於設計,TI等半導體製造商也與第三方合作夥伴密切合作,開發如系統模組等「可立即部署」的硬體元件。這些硬體解決方案的設計旨在支援單一PCB上的特定嵌入式處理器和核心元件。

邊緣AI軟體創新:從硬體觀點來看,隨著嵌入式裝置中高效率AI運算的進步,開放原始碼社群和半導體製造商只需具備最少的編程專業知識,即可測試和部署AI模型,讓創新變得更加容易。若能讓AI更易於使用(在某些情況下是以GUI為基礎),將有助於減少投資額外資源或訓練來增強AI專業知識的需求。

對於較熟悉AI模型的設計人員而言,PyTorch和TensorFlow等開放原始碼平台可透過抽象化解讀各嵌入式平台的許多細節,協助簡化邊緣AI解決方案的開發程序。

若開發人員想進一步簡化AI模型在TI裝置上的測試和部署,則可以使用TI的Edge AI Studio。Edge AI Studio的設計旨在使用遠端TI硬體和圖形使用者介面,簡化並加速TI嵌入式裝置上的邊緣AI應用開發。這些工具包括模型編輯器、模型分析器、模型選擇工具和模型製作器,可協助設計人員快速評估模型及其性能,而無需實際連接至評估板。

使用嵌入式微控制器或微處理器開發產品時,請務必要考慮產品如何隨時間演進與擴充。工程師不想花費數個月的時間在一個微處理器上開發解決方案,然後再將產品更新為更高性能的處理器時又必須從頭開始。

打造嵌入式裝置的半導體製造商必須開發在功能、性能和成本方面具有可擴展性的產品組合,並確保其各種AI嵌入式處理器之間有無縫移轉策略,以使開發人員盡可能簡單地在不同裝置上重複使用其工作。邊緣AI也不例外。例如,製造居家機器人的設計師可能想要同時生產配備三部環景攝影機的高階版本,以及只配備單一前置攝影機的入門級版本。可擴充的視覺處理器產品組合可將軟體從高階機型移植至入門級機型,將生產這兩種產品所需的資源量降至最低。可擴展性也允許開發人員隨著產品的發展,將研發投資從一個平台轉移至下一個平台。

儘管邊緣AI目前仍是相對較新的技術,但其重塑人們日常生活的潛力正逐漸成為人們關注的焦點,特別是為幾乎所有應用帶來更高回應性和更高性能的能力。隨著低功率、經濟高效的嵌入式處理器以及直覺式軟體和模型訓練工具的進步,對於任何經驗程度的設計師而言,使用AI技術從未像現今容易。此種情況將能持續到每一代邊緣AI裝置,以及管理人們與之互動和依賴的電子設備內的運作和資料收集的關鍵元件(例如用於感測、電力傳輸和連接的半導體)。