GPU與人工智慧(AI)伺服器的市場需求,隨著生成式AI應用的發酵而快速成長。資料中心面對大量AI運算需求,需要克服耗電與散熱兩大挑戰。Supermicro總裁暨執行長梁見後表示,直接液冷(DLC)系統相較氣冷系統,可以提升資料中心的散熱效率與能源使用效益。隨著散熱系統的用電不斷減少,採用液冷的資料中心營運成本成可大幅下降。過去DLC常見的挑戰在於可靠度不足,並且難以維護。而目前Supermicro解決方案經過NVIDIA AI Enterprise的軟體優化,已經出貨給客戶。

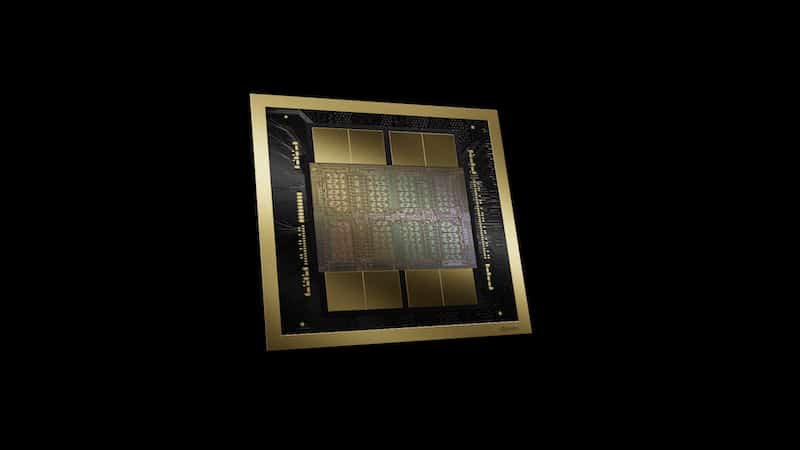

NVIDIA Blackwell GPU透過採用Supermicro的4U液冷系統,單個GPU可以釋出20 PetaFLOPS的AI運算效能,相較前一代GPU,AI訓練的效能增加四倍,推論效能則提高30倍。Supermicro最近推出基於NVIDIA Blackwell架構的新產品,針對包括新的NVIDIA HGXTM B100、B200和GB200 Grace Blackwell超級晶片,提供有效的散熱解決方案。

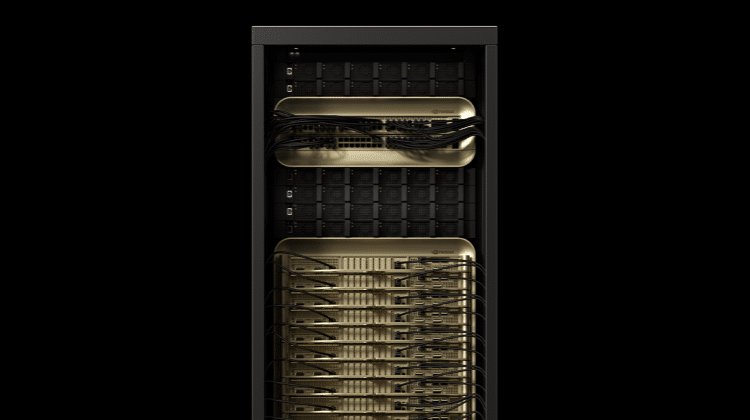

在Computex2024中,Supermicro展示即將推出的針對NVIDIA Blackwell GPU優化的系統,包括基於NVIDIA HGX B200系統的10U氣冷和4U液冷系統。此外,Supermicro將提供基於NVIDIA HGX B100系統的8U氣冷系統和NVIDIA GB200 NVL72機架,其中包含72個由NVIDIA NVLink交換器連接的GPU,以及支援NVIDIA H200 NVL PCIe GPU和新發表的NVIDIA GB200 NVL2架構的新NVIDIA MGX系統。

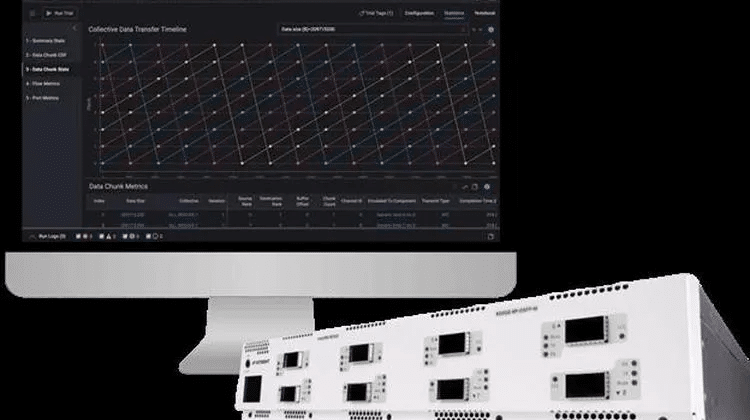

隨著大型語言模型的快速發展,以及Meta的Llama-3和Mistral的Mixtral 8x22B等開源模型的不斷推出,企業更容易採用新興的AI模型。因此簡化AI基礎設施,並以提供具成本效益的解決方案,對支援AI技術發展至關重要。Supermicro的雲端原生AI SuperCluster 解決雲端運算的即時性與移動性不足的問題,透過採用NVIDIA AI Enterprise,任何規模的企業AI專案都可以順利從測試進入生產階段。上述解決方案有助於企業AI應用的靈活性,並且增加數據管理的安全性。