ChatGPT為人工智慧(AI) 取得了階段式的勝利,甚至引爆了全社會對生成式AI和大模型技術的關注。AI大模型由於參數量大, 需要更大體量的資料和更高的算力支撐,因此對晶片用量的更大需求、晶片規格的更高要求,已經成為明顯趨勢。

因為ChatGPT,人工智慧(AI)取得了里程碑式的勝利,甚至引爆了全社會對生成式AI和大模型技術的關注。AI大模型由於參數量大、運算量大, 需要更大體量的資料和更高的算力支撐,因此對晶片用量的更大需求、晶片規格的更高要求,已經成為明顯趨勢。同時,大模型要進一步走向通用,成為全社會必不可少的生產工具,勢必需要更強的訓練、推理能力,以及可接受的使用成本,而這些都在推動大算力晶片的發展變革。它一方面為AI走向普及奠定基礎,反之,則可能限制技術發展。

AI大模型吞噬算力

以ChatGPT為代表的大語言模型(LLM)在過去幾年中,規模每年約增加10倍。有研究指出,隨著LLM模型規模成長,很多NLP任務效果會大幅提升。這也意味著未來的技術趨勢可能是:追求規模越來越大的LLM 模型,透過增加預訓練資料的多樣性,涵蓋越來越多的領域。LLM自主從領域資料中透過預訓練過程學習領域知識,隨著模型規模不斷增大,很多問題隨之解決。也就是說,更智慧的ChatGPT應用,與大模型的複雜程度和規模的進一步增加,是伴隨而來的階躍和挑戰。

ChatGPT對算力的消耗主要分為三個場景:一是模型預訓練過程,這是ChatGPT消耗算力的最主要場景。GPT、GPT-2和GPT-3的參數量從1.17億增加到1,750億,預訓練資料量從5GB 增加到45TB,其中GPT-3單次訓練成本就高達460萬美元。同時,模型開發過程很難一次取得成功,整個開發階段可能需要進行多次預訓練過程,因此對於算力的需求是持續的。

二是模型反覆運算過程。ChatGPT模型需要不斷進行調優,以確保處於最佳應用狀態。這一過程中,一方面需要開發者對模型參數進行調整,確保輸出內容不是有害和失真的。另一方面,需要基於使用者回饋和PPO 策略,對模型進行大規模或小規模的反覆運算訓練。這些都將產生算力成本,且成本取決於模型的反覆運算速度。

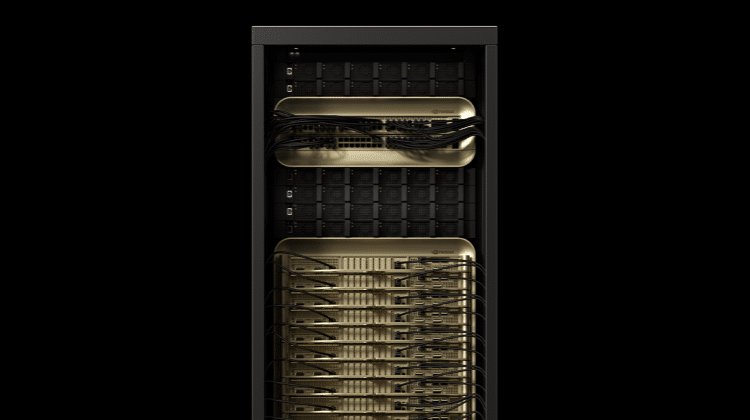

三是日常運營過程。使用者交互帶來的資料處理需求同樣也是一筆不小的算力開支,ChatGPT面向全球大眾用戶,用的人越多,頻寬消耗越大,伺服器成本會越來越高。業界測算ChatGPT 單月運營需要算力約4874.4PFlop/s-day,對應成本約616萬美元。

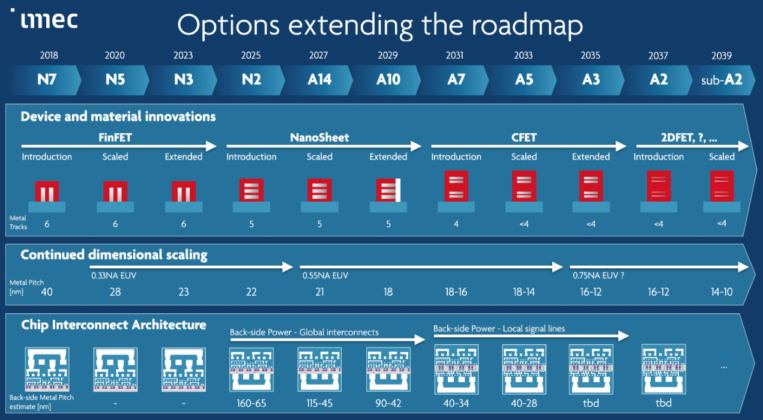

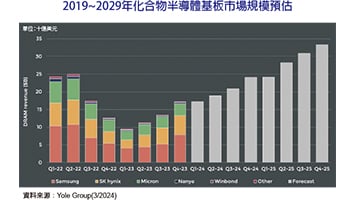

面對ChatGPT這樣大量消耗算力的技術,運算資源很容易捉襟見肘。根據OpenAI預估,自2012年以來,全球領頭的AI模型訓練算力需求3~4個月更新一輪,每年領頭模型訓練所需算力成長幅度高達10倍,AI深度學習正在逼近現有晶片的算力極限,也對晶片設計廠商提出了更高要求。

大算力晶片面臨效能和成本挑戰

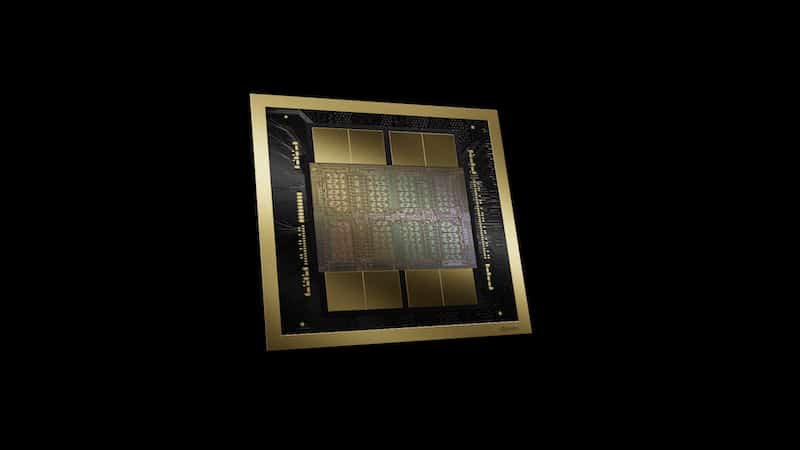

GPU由於採用了數量眾多的運算單元和超長流水線,因此更適合進行大輸送量的AI平行運算。不過,隨著大模型逐步發展, 對GPU先進算力的需求在繼續提升。面向未來更大的運算和部署挑戰,單純的算力提升已經不是最優解。AMD執行長蘇姿丰近期提出,在接下來的十年裡, 必須將能源效率視為最重要的挑戰。

此外,高效能比也是存算一體AI晶片所擅長的,它能從架構上突破傳統資料搬運方式所帶來的瓶頸,實現運算效率數量級的提升。英特爾、三星等IDM廠商和新銳的算力晶片廠商都在探索存算一體晶片,並衍生出了不同的架構和技術路線。在阿裡達摩院發布的2023十大科技趨勢中,多模態預測訓練大模型、Chiplet、存算一體等技術都位列其中,成為算力產業下一步有跡可循的發展方向。