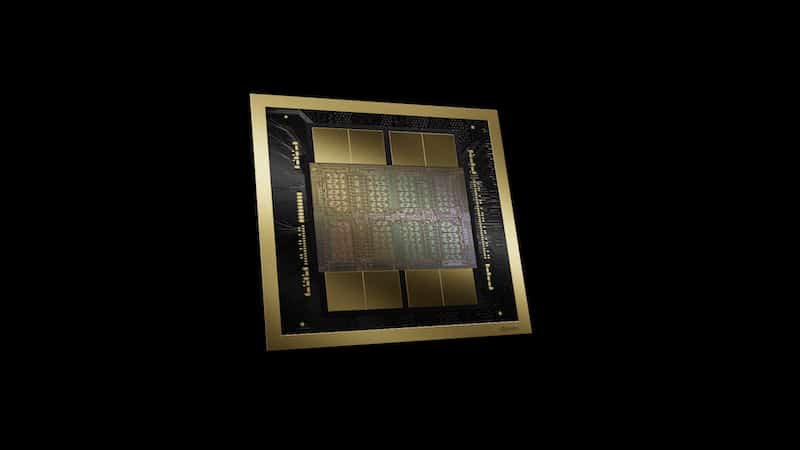

NVIDIA於2023年5月29日宣布 NVIDIA GH200 Grace Hopper超級晶片已開始量產,將為全球即將上線的系統提供動力,以運行複雜的人工智慧和高效運算工作負載。

搭載GH200的系統加入了400多種基於NVIDIA多種最新的CPU、GPU和DPU架構,包括NVIDIA Grace、NVIDIA Hopper、NVIDIA Ada Lovelace和NVIDIA BlueField的系統配置,旨在滿足對生成式人工智慧的大幅增加的需求。

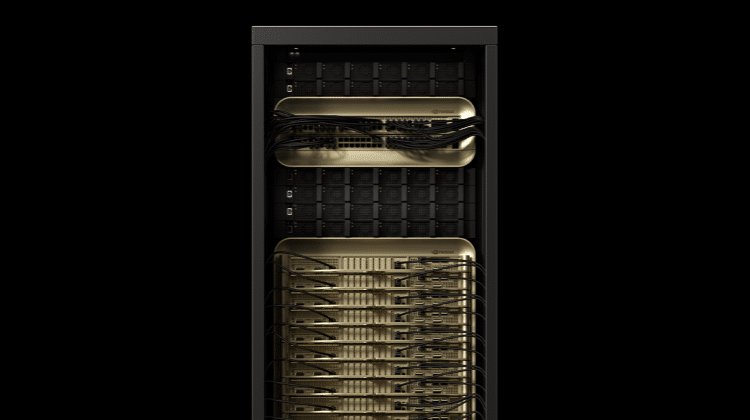

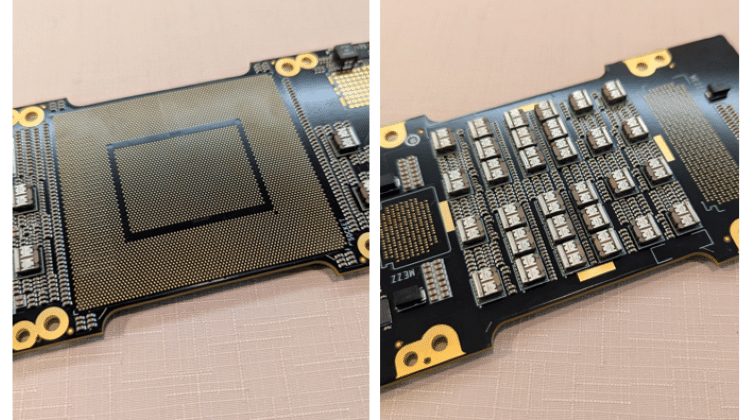

在COMPUTEX上,NVIDIA創辦人暨執行長黃仁勳展示關於GH200 Grace Hopper超級晶片的新系統、合作夥伴和其他詳細資訊。該晶片結合了基於Arm架構的NVIDIA Grace CPU和Hopper GPU,並使用NVIDIA NVLink-C2C連線技術。這提供了高達900GB/s的頻寬,比傳統加速系統中的標準PCIe Gen5的頻寬高7倍,為要求最嚴格的生成式人工智慧和高效能運算應用提供了強大的運算能力。

NVIDIA加速運算副總裁Ian Buck表示,生成式人工智慧正在迅速改變企業,為醫療保健、金融、商業服務和其他眾多產業帶來新機遇並加速研發。隨著Grace Hopper超級晶片的全面投產,全球製造商很快將能提供加速運算的基礎設施,滿足企業建構和部署利用其專用數據的生成式人工智慧應用。

數百款加速系統和雲端執行個體

全球採用最新NVIDIA技術的眾多系統製造商中也包括台灣重要的系統製造商,他們向市場推出由NVIDIA不同加速器和處理器組合的各種系統。NVIDIA台灣合作夥伴包括研揚科技、研華科技、安提國際、永擎電子、華碩、技嘉科技、 鴻佰科技、英業達和碩聯合科技、雲達科技、泰安電腦、緯創資通和緯穎科技(依照公司英文名稱排序)。這些公司皆為 NVIDIA創辦人暨執行長黃仁勳在COMPUTEX上發表主題演講中所提的關鍵合作夥伴。

此外全球伺服器製造商思科、戴爾科技集團、慧與科技、聯想、美超微和Atos 旗下公司Evidian都提供一系列透過NVIDIA加速的系統。Amazon Web Services、Cirrascale、CoreWeave、Google Cloud、Lambda、微軟 Azure、Oracle Cloud Infrastructure、Paperspace 及 Vultr等雲端服務供應商合作夥伴,則都提供NVIDIA H100系統。NVIDIA L4 GPU已可透過Google Cloud取得。

加速系統上的全堆疊運算

即將推出的由 NVIDIA Grace、Hopper和Ada Lovelace架構加速的系統組合全面支援NVIDIA軟體堆疊,其中包括 NVIDIA AI、NVIDIA Omniverse平台和 NVIDIA RTX技術。

NVIDIA AI Enterprise是NVIDIA AI平台的軟體堆疊,提供了超過一百個框架、預先訓練好的模型及開發工具,以簡化開發和部署生產式人工智慧的作業,當中包括生成式人工智慧、電腦視覺和語音人工智慧。

個人和團隊透過用於打造與運行元宇宙應用程式的NVIDIA Omniverse開發平台,能跨越多個軟體套件來執行作業,並且在共用環境中即時進行合作。這一切都是建立在通用場景描述框架之上,這種具開放性及擴充性的 3D 語言,供人們使用建立虛擬世界。

集光線追蹤、深度學習和光柵化技術於一身的NVIDIA RTX平台,支援業界的工具和API,從根本上改變了內容創作者和開發者的創作流程。建立在RTX平台上的應用程式能夠即時渲染出逼真寫實的畫面,還利用人工智慧來強化的繪圖及處理視訊和影像的能力,讓數百萬名設計師和藝術家能夠創作自己滿意的作品。